术语与概念

相机类型

3D 相机是一种能够捕捉三维图像的相机。它通过各种技术手段(如立体视觉、飞行时间、结构光等)获取物体的三维形状和深度信息。3D 相机可以生成具有 3D 空间坐标信息的点云数据,使得计算机能够理解和处理三维空间中的物体。

主动双目立体相机是一种结合了双目立体视觉和主动光源(如结构光)的相机系统。它通过投射已知的光图案到场景中,并使用双目相机捕捉这些图案的变形,从而提高深度测量的精度和鲁棒性。主动双目立体相机在低光照条件下表现尤为出色,适用于各种复杂环境中的3D成像。

ToF(Time of Flight)飞行时间相机是一种通过测量光信号从相机发射到物体并反射回来的时间差来计算距离的 3D 相机,可以广泛应用于机器人导航、手势识别、3D扫描等领域。根据工作原理和应用场景的不同,ToF 相机可以分为以下几种类型:

直接 ToF 相机(dToF)

直接 ToF 相机通过测量光脉冲从发射到接收的时间来计算距离。这种相机通常使用激光或LED作为光源,具有高精度和快速响应的特点。直接ToF相机适用于需要高精度深度测量的应用,如工业自动化、机器人导航和3D扫描。

间接 ToF 相机(iToF)

间接 ToF 相机通过测量连续调制光信号的相位差来计算距离。这种相机通常使用调制的红外光源,具有较高的抗干扰能力和较低的功耗。间接ToF相机广泛应用于消费电子产品,如智能手机、平板电脑和游戏设备中的手势识别和人脸识别。

立体匹配是一种计算机视觉技术,用于从双目立体相机拍摄的两幅图像中找到对应的像素点。通过比较左右图像中的像素,计算它们之间的视差,从而推算出物体的深度信息。立体匹配是双目立体视觉系统中的关键步骤,影响深度图的精度和质量。

结构光是一种通过投射已知的光图案(如条纹、网格、点阵)到场景中,并分析这些图案在物体表面的变形来计算深度信息的技术。结构光系统通常包括一个投影仪和一个相机,通过捕捉和处理变形后的图案,可以生成高精度的三维图像。结构光广泛应用于3D扫描、工业检测、手势识别等领域。

相机部件

一种能够捕捉和记录彩色图像的传感器,通过光电二极管和滤光片阵列将光信号转换为电信号,并经过图像处理生成彩色图像。

镜头,透镜组。通常由一块或者多块光学玻璃组成的透镜组,一般由凹透镜、凸透镜,或其组合组成。用于汇聚,折射光线,将光线投射到图像传感器上。

Image Signal Processor,图像信号处理器。用于对彩色图像进行后处理。

一种能够检测和捕捉光线的传感器,通过光电二极管和滤光片阵列将光信号转换为电信号,并经过图像处理生成灰度图。

用于发射结构光图案的部件。

Field-Programmable Gate Array,现场可编程门阵列,一种信号处理芯片。FPGA具有高度并行的处理能力,可以同时执行大量的逻辑运算。在图像处理任务中,例如图像预处理、特征提取和图像识别等,需要大量的计算任务。FPGA可以通过并行处理技术,将这些任务同时执行,从而大大提高图像处理的效率。

System on Chip,芯片级系统,也有称片上系统。一个将处理器或其他电子系统集成到单一芯片的集成电路。SoC 系统可以处理数字信号、模拟信号、混合信号甚至更高频率的信号。SoC 系统常常应用在嵌入式系统中。

使用红外光照亮环境,用于给红外成像补光。

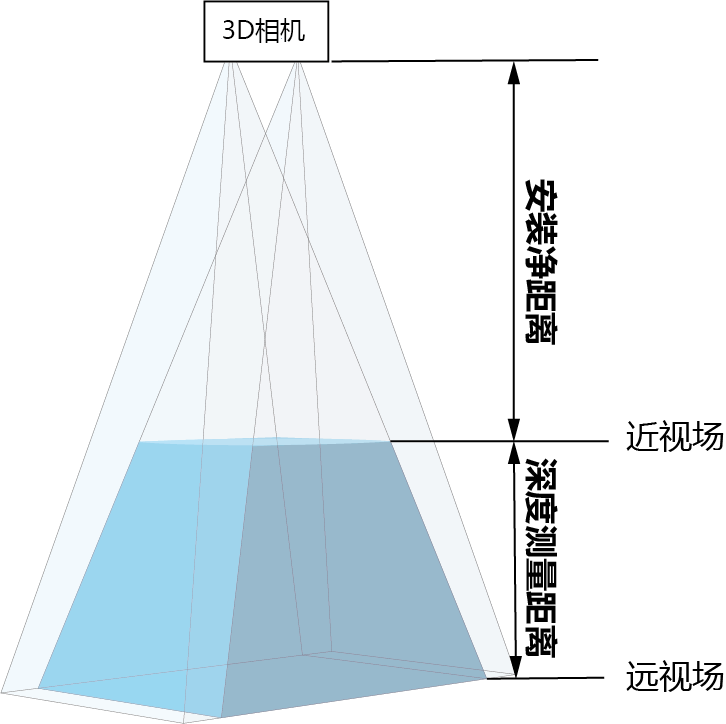

相机基础

基线是指立体相机系统中两个相机之间的距离。基线越长,立体相机的深度测量精度越高,但也会增加系统的复杂性。

视差是指立体相机系统中,同一物体在左右图像中的位置差异。视差越大,物体离相机越近;视差越小,物体离相机越远。

视场角是相机能够捕捉到的场景的角度范围,通常以水平和垂直角度表示。视场角越大,相机能够覆盖的区域越广。

图像分辨率是指相机捕捉图像的像素数量,通常以宽度×高度表示。分辨率越高,图像越清晰。

快门是控制相机曝光时间的装置。快门速度越快,曝光时间越短,适用于捕捉快速运动的物体。

景深是指在图像中能够清晰成像的前后距离范围。景深越大,更多的物体在不同距离上都能清晰成像。

相机坐标系是以相机为参考点的三维坐标系,用于描述物体在相机视野中的位置和方向。

内参是描述相机内部光学特性的参数,包括焦距、主点位置、畸变系数等,用于将三维点投影到二维图像平面。

外参是描述相机在世界坐标系中的位置和方向的参数,包括旋转矩阵和平移向量,用于将世界坐标系中的点转换到相机坐标系。

畸变系数是描述相机镜头畸变程度的参数,包括径向畸变和切向畸变,用于校正图像中的几何失真。

标定是通过特定的算法和标定板,确定相机的内参和外参,以提高相机的测量精度和图像质量。

焦距是指相机镜头的光学中心到图像传感器的距离,影响视场角和图像放大倍率。

光圈是控制进入相机镜头的光量的装置,光圈越大(f值越小),进入的光量越多,适用于低光环境。

相机性能

Z 方向上,测得的距离值与距离真值之间的平均偏差。

视野内中心区域所有像素点相对于理想平面的离散程度。

视野内中心区域所有像素点深度值在时域上的离散程度。

深度图上像素点间距对应的真实物理距离(单位:mm)。

图像基础

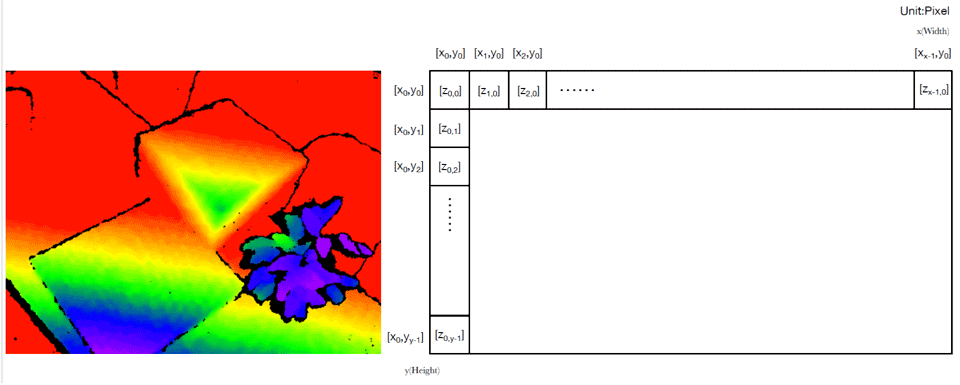

深度图(Depth 图)是深度相机视野内所有点的深度数据构成的一个 16bit 位深的单通道矩阵。为直观地体现不同距离值,在 SDK 示例程序中,输出的深度图均被映射到了 RGB 色彩空间,所以显示出来的结果为 RGB 三通道 8bit 位深的位图。

深度图中的单个像素值是空间中物体的某个点到垂直于左单色镜头光轴并通过镜头光心(深度相机光学零点)平面的垂直距离。深度数据单位为毫米,没有深度数据的点值为 0。深度数据无外参,只提供用于转换点云数据的内参。主动双目相机输出的深度数据无畸变,ToF 相机输出的深度数据有畸变。

深度图定义

深度图数据格式

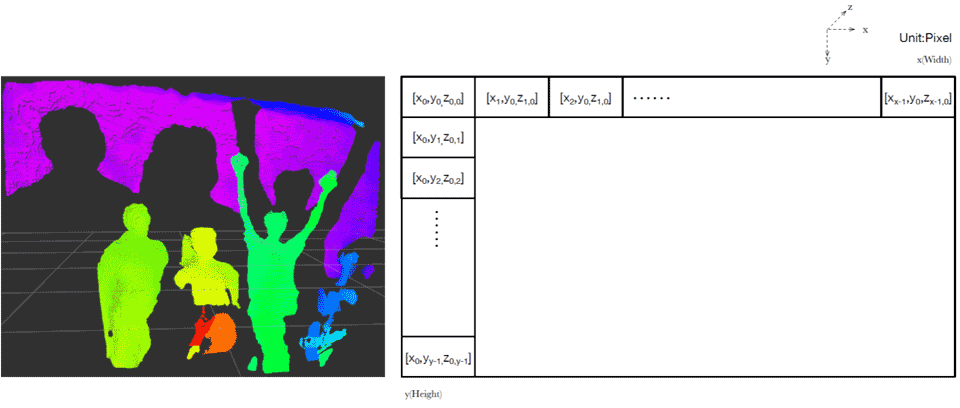

点云图(Point Cloud 图)是深度相机视野内所有点的点云信息构成的数据矩阵。每个点的点云信息为三维坐标(x,y,z)。没有三维空间信息的点为(x,y,0)。

点云图数据格式

灰度图(mono 图)是单色图像传感器输出的图像。在输出深度图的时候,部分型号的 Percipio 深度相机输出的灰度图是被系统处理过的图像,如果需要看原始的灰度图,需要关闭深度图输出。灰度图分为左灰度图和右灰度图,二者均包含内参和畸变参数,但是因为左灰度图和深度图是同一个空间坐标系,所以左灰度图无外参。主动双目相机输出左右灰度图,ToF 相机输出左灰度图。

彩色图(RGB 图)是彩色图像传感器输出的图像。彩色图像传感器组件提供了内参,外参,畸变参数。不同型号的 Percipio 深度相机会输出不同数据类型的彩色图。

含有硬件 ISP 模块的彩色图像传感器输出为正常的 YUYV422/JPEG 图像,经 OpenCV 处理即可显示为正常色彩空间的彩色图。

不含硬件 ISP 模块的彩色图像传感器输出为 RAW BAYER 图像,图像画面可能存在偏色现象,经过 SDK 的软件 ISP 处理(如白平衡),才可以显示为正常色彩空间的彩色图。没有硬件 ISP 模块的彩色图像传感器可以确保输出的图像数据与灰度图像数据同步。

由于噪音、反光等原因导致深度图数值(或点云图连续表面)突然出现的异常离群点。

在 ToF 相机的深度图或点云中,飞点一般是由于多路径干扰引起的;ToF 多路径干扰指多条发射端光线经过不同的反射路线或一条光线多次反射进入TOF sensor 同一个像素点,从而引起了TOF 深度图的异常。

相机输出图像中的粗糙部分或者图像信息(灰度、亮度等)的随机变化。

信号(即图像的有用信息)与噪声(即图像中的随机干扰或不需要的信息)之间的比率。SNR 通常用分贝(dB)表示,数值越高,表示图像质量越好,噪声越少。

相机的彩色图和深度图像数据在时间上同步输出。

图像中最亮部分和最暗部分之间的亮度差异。对比度是图像质量的重要指标之一,它影响图像的清晰度、细节表现和视觉效果。

高对比度:图像中亮部和暗部的差异较大,图像看起来更加鲜明和锐利。高对比度的图像通常具有更强的视觉冲击力,但可能会丢失一些细节,尤其是在亮部和暗部。

低对比度:图像中亮部和暗部的差异较小,图像看起来更加柔和和平淡。低对比度的图像可能显得灰暗和模糊,但能够保留更多的细节。

亮度是图像中光的强度和明暗程度的度量,是影响图像视觉效果的重要因素。亮度不仅仅是灰度值,还可以受到图像对比度和色彩的影响。

在数字图像处理中,亮度通常用灰度值来表示。以8bit图像为例,灰度值是一个从0到255的整数,其中,0 表示完全黑色(无光);255 表示完全白色(最大光强);中间的值表示不同程度的灰色。

对于彩色图像,亮度可以通过将RGB(红、绿、蓝)三种颜色的值进行加权平均来计算。例如,常用的亮度计算公式是:亮度= 0.299 * R + 0.587 * G + 0.114 * B 这个公式反映了人眼对不同颜色的敏感度,其中绿色对亮度的贡献最大,红色次之,蓝色最小。

灰度是图像处理中一种表示图像亮度信息的方式。灰度图像是一种没有颜色信息的图像,每个像素只有一个强度值,表示从黑到白的亮度。灰度值通常在 0 到 255 之间,其中 0 表示黑色,255 表示白色。

图像处理

D2C(Depth To Color)是指根据深度相机和彩色相机的内外参数将深度图上每个像素点映射到彩色图的对应位置,从而得到 RGBD 图。

C2D(Color To Depth)是指根据深度相机和彩色相机的内外参数将彩色图上每个像素点映射到深度图的对应位置,从而得到 RGBD 图。

放大来自图像传感器的数字信号。增加数字增益,图像整体亮度会随之提高,但也会引入更多的噪声,导致图像质量下降,表现为颗粒感增加。

放大来自图像传感器的模拟信号。增加模拟增益,图像整体亮度会随之提高。调整模拟增益有助于在保持一定图像质量的前提下,优化传感器对低照度环境的适应能力。

图像传感器接光信号的时间。曝光时间越长,图像越亮。

自动调整相机的曝光设置(如快门速度、光圈大小和ISO感光度),以确保拍摄的彩色图具有适当的亮度和对比度。

环境光的色温会影响彩色图像的外观,自动白平衡是通过自动调整Blue(蓝色)、Green(绿色) 和Red(红色)色彩比例,对环境色温所造成的颜色偏差和相机固有的色彩偏差进行一定的补偿,从而让获得的图像能正确反映物体的真实色彩。

根据彩色图 ROI 区域内的亮度值自动调整曝光时间,使 ROI 区域内的亮度值达到正常水平。

修正由于镜头光学特性引起的图像畸变,使图像更加接近真实场景的过程。

高动态范围(HDR)通过组合多张不同曝光时间的图像,从而保留亮部和暗部细节,主要适用于高对比度的拍摄场景。

软件类

Software Development Kit,软件开发工具包。SDK 是一组工具、库、文档和示例代码的集合,旨在帮助开发者创建应用程序或软件系统。

Application Programming Interface,应用程序编程接口。API 是一组定义和协议,用于构建和集成软件应用程序。它可以实现不同的软件系统之间进行通信和数据交换。

可靠性

激光安全等级是根据国际标准(如IEC 60825-1)对激光设备的潜在危害进行分类的系统。不同等级表示激光对人眼和皮肤的潜在风险,从Class 1(安全)到Class 4(高危险)。在3D相机中,激光安全等级决定了设备在使用时对用户的安全性要求。

温度漂移是指由于环境温度变化导致3D相机性能参数(如焦距、深度测量精度等)发生变化的现象。温度漂移可能影响相机的测量精度和稳定性,因此在设计和使用3D相机时需要考虑温度补偿和校准。